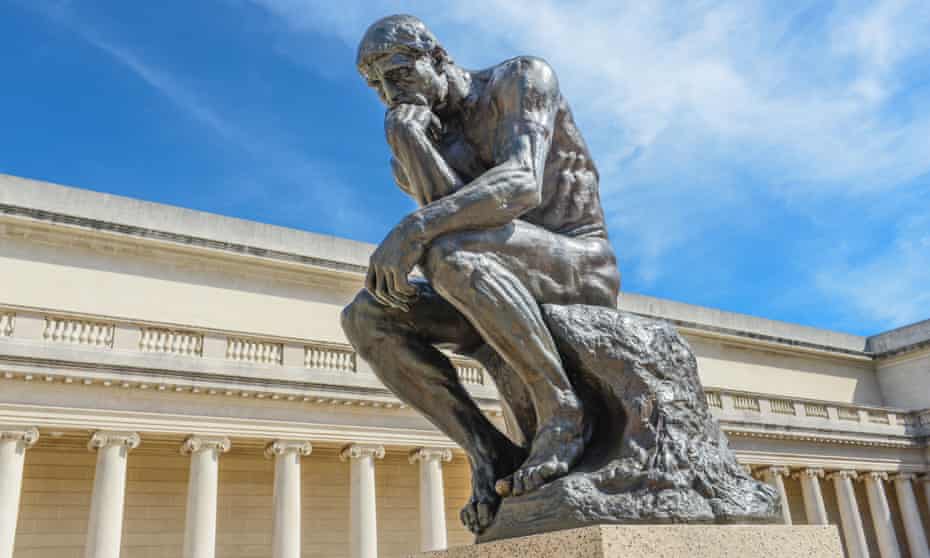

Mund ta zgjidhë roboti një dilemë morale?

Dilemat morale, për nga natyra e tyre, janë të vështira për t’u zgjidhur. Kjo është arsyeja pse të njëjtat pyetje etike rishfaqen vazhdimisht në televizion, filma dhe letërsi. Por çka nëse inteligjenc...

Poppy Noor

Mund ta zgjidhë roboti një dilemë morale?

Poppy Noor

Dilemat morale, për nga natyra e tyre, janë të vështira për t’u zgjidhur.

Kjo është arsyeja pse të njëjtat pyetje etike rishfaqen vazhdimisht në televizion, filma dhe letërsi.

Por çka nëse inteligjenca artificiale mund të largojë punën e trurit dhe t’u përgjigjet pyetjeve etike për ne?

Ask Delphi është një robot, të cilit i janë dhënë më shumë se 1.7 milionë shembuj të gjykimeve etike të njerëzve për pyetjet dhe skenarët e përditshëm.

Nëse i jepni një telash etik, ai do t’ju tregojë nëse diçka është e drejtë, e gabuar ose e pambrojtshme.

Çdokush mund ta përdorë Delphi-n. Përdoruesit thjesht i bëjnë një pyetje robotit në faqen e tij të internetit dhe shohin se çfarë del.

Inteligjenca artificiale ushqehet me një numër të madh skenarësh, duke përfshirë ato nga Reddit i njohur si Am I The Asshole, ku përdoruesit postojnë dilema nga jeta e tyre personale dhe bëjnë që një audiencë të gjykojë se kush është gabim aty.

Më pas, njerëzit rekrutohen nga Mechanical Turk – një treg ku studiuesit gjejnë pjesëmarrës të paguar për studime – për të thënë nëse janë dakord me përgjigjet.

Çdo përgjigje u jepet tre arbitrave, ku shumica përdoret për të ndarë të drejtën nga e gabuara.

Procesi është përzgjedhës – pjesëmarrësit duhet të arrijnë rezultate të mira në një test për t’u kualifikuar si arbitër moral dhe studiuesit nuk rekrutojnë njerëz që tregojnë shenja racizmi ose seksizmi.

Arbitrat pajtohen me gjykimet etike të robotëve në 92 për qind të rasteve.

Në tetor, një artikull i “New York Times” për një shkrimtare që mund të kishte bërë plagjiaturë, hapi debat.

Padyshim që roboti nuk e lexoi artikullin, as shpërthimin e temave dhe postimeve në Reddit. Por ka lexuar shumë më tepër se shumica prej nesh.

Atij i janë bërë mbi tre milionë pyetje të reja që kur u fut në internet.

E pyeta Yejin Choi, një nga studiueset nga Universiteti i Washington-it, e cila punoi në projekt së bashku me kolegët në Institutin Allen për inteligjencën artificiale, se si Delphi mendon për këto pyetje.

Sipas saj, “është i vëmendshëm ndaj mënyrës se si e thoni pyetjen. Edhe pse mund të mendojmë se jemi konsistent, në realitet, njerëzit përdorin nënkuptime dhe kualifikime. Delphi po përpiqet të lexojë atë që ju kërkoni, pikërisht në mënyrën se si e shprehni”.

Me këtë në mendje, u përpoqëm të parashtronim disa nga pyetjet e mëdha të politikës, kulturës dhe letërsisë.

Ai u përgjigjet edhe disa pyetjeve me nuanca të habitshme.

Për shembull, dallon nëse është e vrazhdë të kositësh barin vonë natën, kundrejt asaj nëse është në rregull të kositësh barin natën vonë kur fqinji është jashtë qytetit.

Por versionet e mëparshme të robotit iu përgjigjën pyetjes së Vox-it “a është gjenocidi në rregull”, duke pohuar se është “nëse i bën të gjithë të lumtur”.

Një version i ri i Delphi-t, i cili u prezantua javën e kaluar, tani përgjigjet se kjo gjë “është gabim”.

Choi thekson se roboti ka të meta, por jetojmë në një botë ku njerëzit vazhdimisht kërkojnë përgjigje nga njerëzit e papërsosur dhe mjetet si Reddit dhe Google.

“Dhe interneti është i mbushur me lloj-lloj përmbajtjesh problematike. E dini, disa njerëz thonë se duhet të përhapin lajme të rreme, për shembull, për të mbështetur partinë e tyre politike”, ka shtuar ajo.

Pra, mund të argumentohet se e gjithë kjo na tregon vërtet nëse pikëpamjet e robotit janë në përputhje me një përzgjedhje të rastësishme të njerëzve, në vend të asaj se diçka është me të vërtetë e drejtë apo e gabuar.

Choi ka sqaruar se kjo është në rregull.

“Testi është tërësisht me burime të shumta, nuk janë qenie njerëzore të përsosura, por janë më të mirë se njerëzit mesatarë të Reddit”, ka shtuar ajo.

Megjithatë, e bën të qartë se qëllimi i robotit nuk është të jetë një autoritet moral.

Në vend të kësaj, qëllimi i robotit është të ndihmojë inteligjencën artificiale që të punojë më mirë me njerëzit dhe të eliminojë disa nga paragjykimet e shumta që tashmë e dimë se ka.

“Duhet të mësojmë vlerat etike të inteligjencës artificiale sepse ai ndërvepron me njerëzit. Dhe për ta bërë këtë, duhet të jetë i vetëdijshëm se çfarë vlerash kanë njerëzit”, ka theksuar Choi.

Marrë nga “The Guardian”.